随着人工智能技术深度融入医疗、金融、制造等关键领域,AI产品的可靠性、安全性及合规性已成为全球关注的焦点。据IDC数据显示,2025年全球AI市场规模将突破5000亿美元,但随之而来的算法偏见、数据泄露、决策失控等风险也在加剧。为保障用户权益与产业发展,建立涵盖功能验证、安全评估、性能测试及伦理审查的完整检测体系,已成为AI产品商业化落地的必经之路。

人工智能产品的检测维度主要包含四大核心方向:

1. 功能验证检测:通过典型场景测试集验证算法准确率,如人脸识别系统需通过LFW、MegaFace等基准数据集验证,NLP产品需通过GLUE、SuperGLUE等测试框架评估语义理解能力。

2. 安全评估检测:包括数据隐私保护(GDPR/CCPA合规性)、对抗样本防御(FGSM/PGD攻击测试)、算法漏洞扫描(MITRE ATT&CK框架)等专项检测。

3. 性能压力测试:涵盖硬件资源利用率(GPU/TPU计算效率)、响应延迟(99分位时延)、系统鲁棒性(高并发/异常输入场景)等关键指标。

4. 伦理合规审查:依据《人工智能伦理建议书》对算法可解释性、公平性(Bias检测)、社会影响等进行评估,推荐使用IBM AI Fairness 360工具包进行量化分析。

针对AI产品的特殊性,检测机构通常采用复合型检测方法:

黑盒测试法:在不了解内部结构的情况下模拟用户行为,通过输入输出分析验证功能完整性,适用于对话系统、推荐引擎等应用层产品。

白盒测试法:基于模型结构进行代码审计(如PyTorch模型检查)、梯度分析(Saliency Map可视化)、决策树追溯等深度检测,多用于自动驾驶、医疗诊断等高危领域。

对抗测试法:采用生成对抗网络(GAN)构造对抗样本,验证系统在噪声干扰、数据污染等极端场景下的稳定性,检测标准需满足NIST SP 1800-30规范。

长期监测法:部署持续集成(CI/CD)管道进行模型漂移检测,当预测准确率下降3%或特征分布偏移超过KL散度阈值时触发报警。

当前AI产品检测遵循多维标准体系:

国际标准:ISO/IEC 24029(AI系统稳健性评估)、IEEE 7001(伦理对齐标准)、欧盟AI法案风险分级制度(禁止/高/有限/最低风险四类管控)。

行业标准:医疗AI需符合FDA SaMD框架(软件即医疗器械)、自动驾驶应符合ISO 21448预期功能安全(SOTIF)标准。

国内标准:GB/T 35273《个人信息安全规范》、AIIA《人工智能开发平台评估规范》及新发布的《生成式人工智能服务管理暂行办法》构成基础框架,重点检测数据标注质量(需达98%以上准确率)、算法备案合规性等要素。

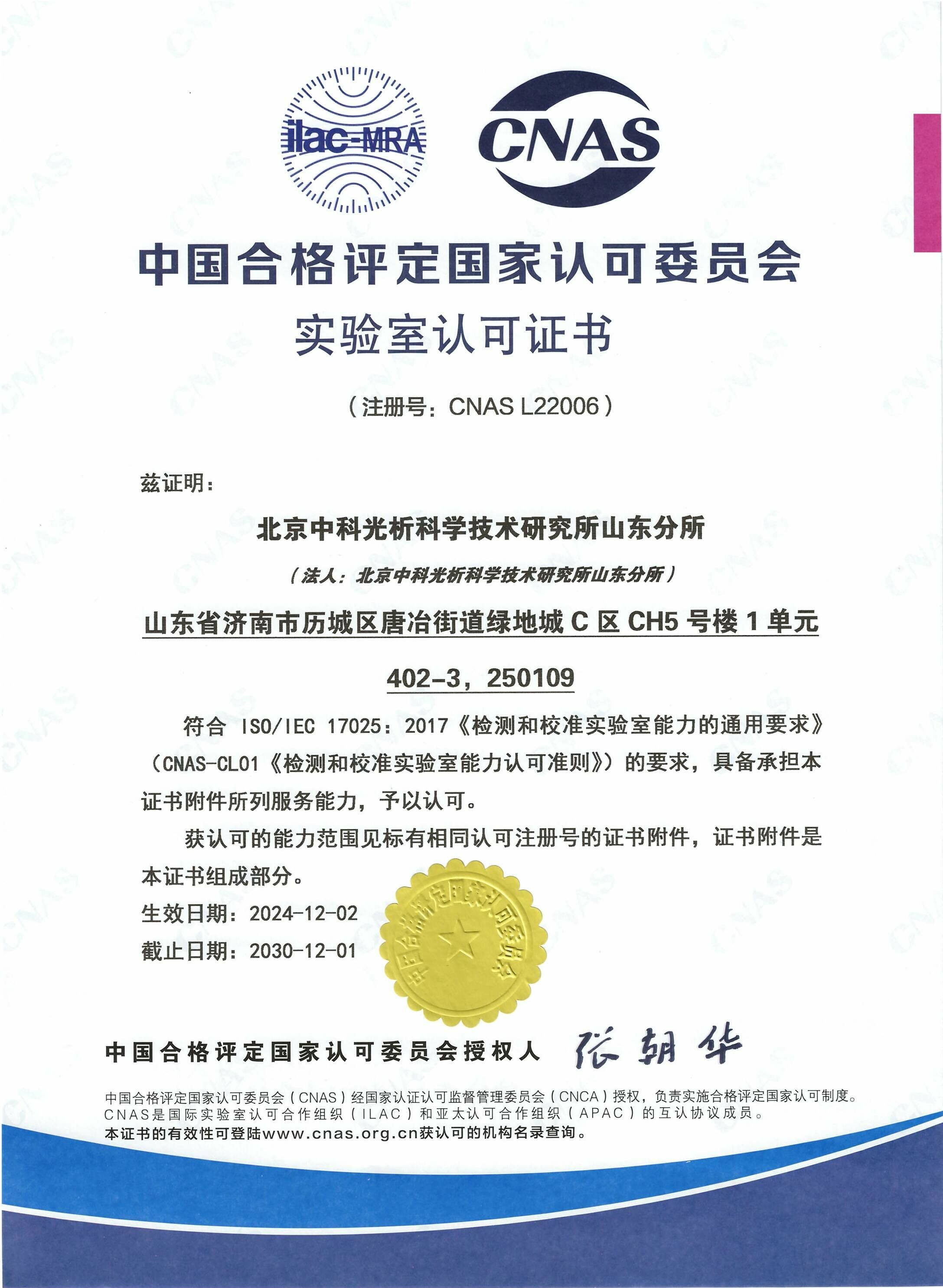

检测机构需同步参照CNAS-CL01:2018实验室认可准则,配备MLCommons测试基准套件、TensorFlow Model Analysis等专业工具,确保检测过程可追溯、结果可复现。

前沿科学

微信公众号

前沿科学

微信公众号

中析研究所

抖音

中析研究所

抖音

中析研究所

微信公众号

中析研究所

微信公众号

中析研究所

快手

中析研究所

快手

中析研究所

微视频

中析研究所

微视频

中析研究所

小红书

中析研究所

小红书